Künstliche Intelligenz und die Zukunft des wissenschaftlichen Verständnisses: Eine philosophische und praktische Analyse

Die transformative Rolle der KI in den Naturwissenschaften

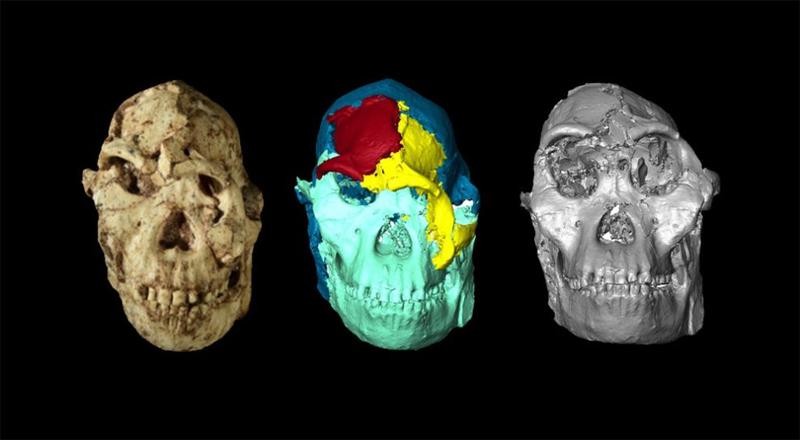

Künstliche Intelligenz (KI) hat die Naturwissenschaften in den letzten Jahrzehnten tiefgreifend verändert. Ein paradigmatisches Beispiel ist AlphaFold, eine KI, die die dreidimensionale Struktur von Proteinen mit bisher unerreichter Genauigkeit vorhersagen kann. Diese Leistung wurde 2024 mit dem Nobelpreis für Chemie ausgezeichnet und markiert einen Wendepunkt in der Biologie. KI-Systeme werden zunehmend auch in der Chemie eingesetzt, um neuartige Moleküle und Materialien zu entdecken, die beispielsweise in der Medikamentenentwicklung oder für Photovoltaiksysteme genutzt werden können. Ein KI-System hat sogar einen Wirkstoff gegen die idiopathische Lungenfibrose identifiziert, der sich bereits in klinischen Phase-2a-Studien befindet. Diese Erfolge zeigen, dass KI in der Lage ist, komplexe wissenschaftliche Probleme zu lösen, die bisher als unlösbar galten.

Wissenschaftliches Verständnis: Eine philosophische Herausforderung

Trotz dieser beeindruckenden Fortschritte bleibt die Frage, ob KI nicht nur Ergebnisse liefern, sondern auch wissenschaftliches Verständnis erlangen kann. Wissenschaftliches Verständnis geht über die bloße Vorhersage von Ergebnissen hinaus und beinhaltet die Fähigkeit, die zugrunde liegenden Mechanismen und Prinzipien zu begreifen. Der deutsch-amerikanische Philosoph Carl Gustav Hempel betrachtete Verständnis als ein psychologisches Konzept, das sich einer logischen Analyse entzieht. Andere Wissenschaftler, wie Lord Kelvin und Erwin Schrödinger, betonten die Bedeutung von mechanischen Modellen und Visualisierungen für das Verständnis. Schrödinger entwickelte eine neue Formulierung der Quantenmechanik, die Quantenzustände als Wellen beschreibt und damit eine anschauliche Interpretation liefert.

Eine operationalisierbare Theorie des wissenschaftlichen Verständnisses

Die niederländischen Philosophen Henk de Regt und Dennis Dieks haben eine Theorie entwickelt, die wissenschaftliches Verständnis operationalisierbar macht. Sie definieren zwei zentrale Kriterien: Ein Phänomen ist wissenschaftlich verstanden, wenn es eine Erklärung gibt, die auf einer verständlichen Theorie basiert und den epistemischen Werten der empirischen Angemessenheit und inneren Konsistenz genügt. Eine Theorie ist verständlich, wenn Wissenschaftler ihre qualitativen Konsequenzen erkennen können, ohne exakte Berechnungen durchführen zu müssen. Diese Kriterien sind unabhängig vom verstehenden System und können daher auch auf KI angewendet werden. Sie bieten einen Rahmen, um zu untersuchen, ob und wie KI zum wissenschaftlichen Verständnis beitragen kann.

Die drei Rollen der KI im wissenschaftlichen Erkenntnisprozess

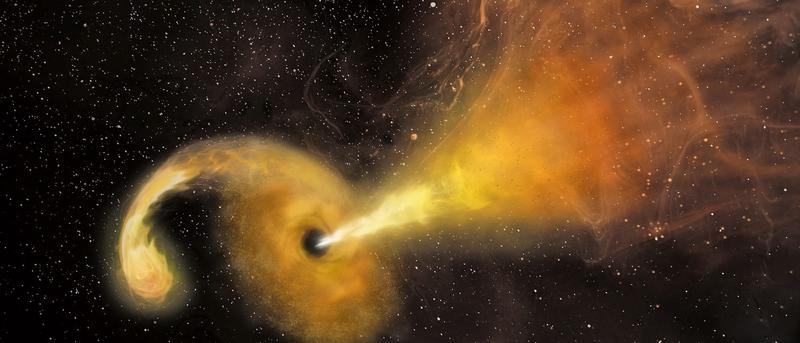

KI kann auf verschiedene Weisen zum wissenschaftlichen Verständnis beitragen. Erstens kann sie als rechnergestütztes Mikroskop fungieren, das Experimente in virtuellen Umgebungen durchführt und Eigenschaften beobachtet, die sonst nicht zugänglich wären. Ein Beispiel ist die Nutzung von VR-Brillen, um komplexe Daten immersiv zu erkunden. Diese immersiven Visualisierungen ermöglichen es Wissenschaftlern, Daten auf eine intuitive Weise zu erfassen und neue Einsichten zu gewinnen. Zweitens kann KI als Inspirationsquelle dienen, indem sie überraschende Zusammenhänge entdeckt oder Wissensgraphen erstellt, die wissenschaftliche Konzepte vernetzen. Ein Beispiel ist die Nutzung von KI in Teilchendetektoren am CERN, wo Algorithmen nach subtilen Mustern in den Daten suchen, die auf neue physikalische Phänomene hindeuten könnten. Drittens kann KI verständliche Ergebnisse liefern, etwa durch die Generierung mathematischer Formeln, die komplexe Prozesse beschreiben. Ein Beispiel ist die symbolische Regression, die kompakte Formeln findet, welche die Eingabedaten beschreiben.

Die Grenzen der KI: Kann sie autonom wissenschaftliches Verständnis erlangen?

Trotz dieser Fortschritte gibt es bisher keine dokumentierten Beispiele dafür, dass KI autonom wissenschaftliches Verständnis erlangt hat. Ein Ansatz, um das Verständnis einer KI zu testen, ist die „knowledge distillation“, bei der ein kleines Modell ein größeres imitiert. Allerdings bleibt unklar, ob das große Modell die Informationen tatsächlich effizient codiert hat. Eine alternative Methode ist ein Test des wissenschaftlichen Verständnisses, der auf der Fähigkeit einer KI beruht, ihr Wissen an Menschen zu vermitteln. Dieser Test ähnelt dem Turing-Test, konzentriert sich jedoch auf die Lehrfähigkeit der KI. Bisher gibt es keine KI, die diesen Test bestanden hat, aber die Entwicklung einer „Teacher-AI“ könnte ein vielversprechender Ansatz sein. Eine solche Teacher-AI könnte Lösungen finden oder aufbereiten und sie Menschen auf eine verständliche Weise erklären.

Die Zukunft der KI in der Wissenschaft: Eine Teacher-AI als Brücke zum Verständnis

Die Entwicklung einer Teacher-AI könnte die Art und Weise, wie wir wissenschaftliches Verständnis erlangen, revolutionieren. Eine solche KI könnte nicht nur Lösungen finden, sondern diese auch auf eine Weise vermitteln, die für Menschen verständlich ist. Sie könnte auf wissenschaftliche Werkzeuge zugreifen, um komplexe Konzepte zu visualisieren, zu vereinfachen oder zu verallgemeinern. Zudem könnte sie Übungen entwickeln, um das Verständnis der Lernenden zu testen und deren Fortschritt im Lehrprozess zu verfolgen. Obwohl es bisher keine dezidierten Arbeiten in diese Richtung gibt, ist es wahrscheinlich, dass wir in naher Zukunft erste Versuche von Teacher-AIs sehen werden. Diese könnten uns ermöglichen, selbst die unintuitivsten und überraschendsten Lösungen von KIs zu verstehen und damit große Fortschritte in der Wissenschaft zu erzielen.